TxT360:一個用於大語言模型訓練的全球去重的高品質資料集 5.7兆個高品質的tokens

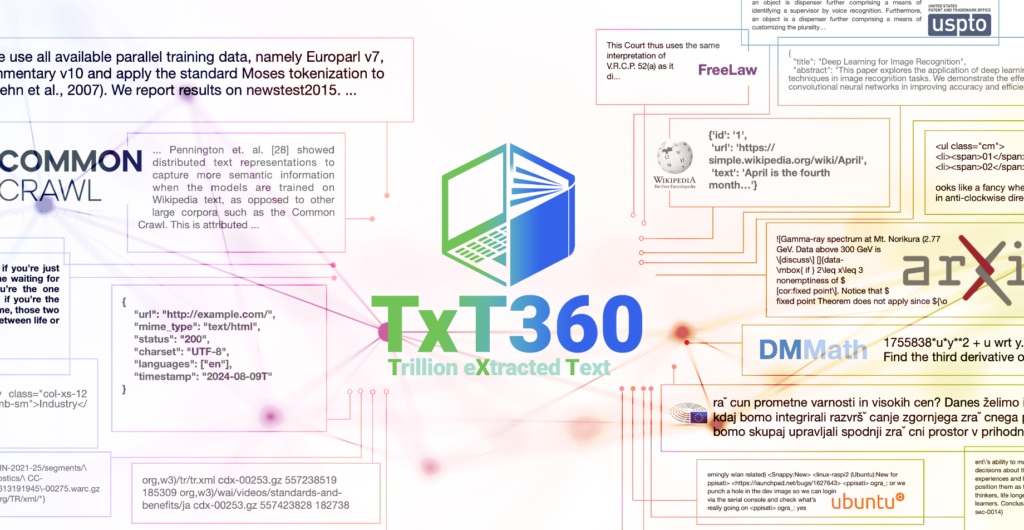

TxT360 是由 LLM360 創建的一個 Hugging Face 上用於大語言模型訓練的資料集。該數據集包含了來自多個領域的高品質文字數據,總計超過15兆個tokens,去重後的約5.7兆個高品質的tokens。

該資料集透過全球去重技術解決了跨資料集的重複問題,同時保留了高品質的精選資料來源。 TxT360在規模和效能上超越了FineWeb和RedPajama等現有資料集,讓預訓練者更好地控制資料分佈和上採樣技術,從而優化模型訓練。

99個Common Crawl快照:資料集包含了99個從網路上抓取的網頁資料集

14個精選資料來源:除了網頁抓取的資料外,該資料集還包括14個高品質的精選資料來源,例如法律文件、百科全書等,

資料權重調整配方:這個資料集也提供了一種方法(配方),讓使用者可以根據不同的資料來源或需求調整資料的權重。這意味著使用者可以靈活地決定哪些資料在模型訓練中應該佔更大的比例,以優化模型的效能。

資料來源與去重:TxT360 匯集了來自多個領域的數據,例如法律文件(FreeLaw)和歷史書籍(PG-19)等,也包含了CommonCrawl上的99個大規模網頁快照。為了確保資料的獨特性,專案進行了複雜的去重操作,確保相同內容不會多次出現。

多樣化的資料來源:TxT360結合了99個CommonCrawl快照和14個精選高品質資料來源,如FreeLaw、PG-19、Wikipedia、StackExchange、HackerNews、USPTO等。

去重處理:TxT360是首個對如此大規模的數據進行全球去重的預訓練數據集,去除重複數據,避免了訓練中的數據冗餘和資訊重複現象。透過正規表示式,TxT360移除了文件中的個人識別資訊(PII),如電子郵件和IP位址,確保了資料的隱私和安全性。

規模與品質並重:透過整合網路數據和精選數據來源,TxT360不僅具備大規模的多樣性數據,同時確保了數據的高質量,適用於最前沿的LLM預訓練。

元資料和精確控制:此資料集不僅包含文本,還儲存了豐富的元資料(如每條資料的來源、類別等),使得研究人員能夠精確控制資料的使用和分佈。這意味著他們可以根據不同的需求調整數據的比例。

上採樣策略:他們使用了一個特殊的策略來擴展資料量,最終創造了一個包含15兆個token的超大語料庫,去重後的約5.7兆個高品質的tokens。在多個關鍵指標上,它表現優於其他類似的大規模資料集(如FineWeb 15T)。

先進的權重分配:TxT360 提供了更多的資料權重控制能力,讓使用者可以靈活調整不同資料來源的權重(例如可以增加或減少某種資料來源的使用比例),從而優化語言模型的訓練效果。這種功能在以往的資料集裡並不常見。

資料集分析與訓練效果

簡單上採樣策略:TxT360透過文件的重複次數設定權重,採用了簡單的上採樣方法,創建了一個超過15兆tokens的資料集。上採樣不僅提高了模型的學習速度,還確保了高品質資料來源的合理利用。

學習曲線與評估:透過對1.5兆tokens的採樣進行訓練對比,TxT360的學習曲線優於FineWeb,尤其在關鍵評估指標上表現更為優異,如MMLU和NQ。同時,當結合程式碼資料(如Stack V2)後,學習曲線更為穩定,模型效能有明顯提升。

困惑度(Perplexity)分析:對不同重複模式的數據進行了困惑度分析,顯示出重複出現的數據在某些情況下可能與高品質內容相關。通過Perplexity評估,TxT360在文件去重、時間跨度等方面展示了良好的品質控制效果。