世界上大多數數據,如醫療記錄、播客和財務報表,存在於影像、PDF、音訊檔案或專用知識庫中,這些格式LLMs處理不佳或不被接受。存取和處理這些數據對於人工智慧應用解決現實世界的用例至關重要。

目前的語言模型(LLM)對於這些非結構化資料的直接理解能力有限,而人工解析或傳統方法效率較低,品質不佳。

Fireworks AI推出了一種叫做「Document Inlining」功能,這是一個複合AI系統,透過解析影像或PDF,將非文本內容轉換為LLM可理解的結構化文本,以提升多模態任務的品質。

Document Inlining能夠將非結構化的文件(如PDF、截圖、圖像等)轉化為LLM(大語言模型)可理解的結構化文本,變成能直接用於聊天機器人或AI模型的文字內容。它的核心目標是彌合多模態(圖像和文字)之間的鴻溝,使複雜的文件解析和理解變得更加高效和準確。

準確性:從 PDF 和圖片中提取數據,準確率極高。

靈活性:適用多種複雜格式,不論是掃描件、圖片或表格都能輕鬆解析。

易用性:開發者只需一行程式碼即可啟用,無需額外複雜操作。

主要功能

解析複雜文件結構

自動識別和解析文件中的多種內容,包括文字、表格、圖表以及巢狀佈局。

支援光學字元辨識(OCR),能準確擷取影像中的文字內容。

保留原始文件的層級和語意結構,以便後續處理。

支援多種文件格式

PDF檔案:擷取內文、標題、頁碼、表格及內嵌圖表。

螢幕截圖:從靜態圖像中提取有用的文字資訊。

圖表和表格:解析嵌套的行列結構,並將其轉換為語言模型可處理的格式。

簡單的開發體驗

開發者可以透過API介面呼叫功能,無需複雜的設置,相容OpenAI API 僅需一行程式碼修改。

在 Fireworks 中,啟用Document Inlining功能僅需在現有的 API 中新增一行程式碼

例如:

from fireworks import inline_document

result = inline_document(“example.pdf”)

解析後的文字直接適配語言模型輸入。

模型彈性:適配任何 LLM,包括微調和專用模型。

高品質生成

利用優化的特定領域模型,確保提取內容的準確性和一致性。

能處理包含多種模態的複雜文件內容,提升語言模型在生成任務中的表現。

多模態融合

將視覺資訊(如影像或PDF)與文字內容融合,透過跨模態橋樑,實現統一的資料表示。

支援LLM在複雜文件產生、回答問題或總結時提供更高的準確性和情境理解能力。

應用場景

Document Inlining 在多個領域中展現出強大的實用性:

企業辦公室:快速處理合約、報告或發票的複雜表格內容。

教育領域:解析學術論文中的公式、圖表或嵌套資料。

金融分析:高效率提取報表中嵌入的財務數據或圖表說明。

客戶支援:從截圖或使用者上傳的非文字檔案中自動提取關鍵訊息,提升自動化回應能力。

技術方法

Document Inlining 結合了提示轉換技術,使 LLM 能夠處理 PDF 和包含多張圖片的文件。

透過以下兩步驟方法將影像和 PDF 轉錄為結構化文本,以供 LLM 處理:

1.解析(Parsing):轉錄並解析非文字內容。

2.攝取(Ingest):將解析得到的文字輸入到 LLM 中進行推理和進一步處理。

核心技術方法包括:

OCR與佈局分析

使用先進的OCR技術提取文件中的文字內容,同時透過版面分析(DLA)來理解文件的層次結構(標題、正文、圖表等)。

表格和圖表解析

專用模型針對複雜表格和巢狀圖表進行最佳化,確保資料擷取的準確性和邏輯一致性。

跨模態嵌入

將視覺特徵與語言模型特徵統一到一個多模態表示中,實現內容無縫轉換。

沒有 Document Inlining 時,使用 Qwen 2VL 視覺模型提示「表格中總共有多少個字母 T?」得到明顯錯誤的答案。

使用 Document Inlining 後,利用更聰明的 “Qwen 2.5 72B instruct” 模型,可以得到正確答案。 (不同模型運行時可能會有些許差異。)

目前的局限性

雖然此方法在處理典型文件佈局時表現優異,但在以下情況下仍有一定限制:

高度視覺化的內容:文字很少的圖像。

依賴空間關係的內容:對佈局依賴性較強的文件。

複雜版面的內容:不易轉換為結構化文字的文件。

品質評估

為了評估文件內嵌(Document Inlining)的有效性,設計了兩個實驗,使用了一組 arXiv 文章及相關問題的資料集進行測試。在資料集中,每篇文章以 PDF 格式提供,並隨機選擇了 100 個文章–問題對。這些數據對分別被輸入到指定模型中,最終由 Claude 3.5-Sonnet 選擇更優的答案。我們選擇 Claude 作為評估工具,因為 Anthropic API 原生支援 PDF 攝取。

實驗 1:對比開源 LLM 與 GPT4o

在第一個實驗中,我們比較了一個開源權重的文字模型(Qwen2.5-72B-Instruct)與 GPT4o 的表現。

Qwen2.5-72B-Instruct:使用文件內嵌功能處理每個 PDF,解析為結構化文字後輸入模型。

GPT4o:接收每頁 PDF 作為影像輸入。

結果

在所有測試對比中,Qwen2.5-72B-Instruct 的回答在 68% 的情況下優於 GPT4o。

實驗 2:同一 VLM 的不同配置對比

在第二個實驗中,我們比較了同一個視覺語言模型(Qwen2-VL-72B-Instruct)在兩種不同配置下的表現:

使用文件內嵌功能處理 PDF,將其解析為結構化文字。

不使用文件內嵌功能,而是逐頁將 PDF 轉換為影像輸入模型。

結果

實驗結果清楚地表明,啟用文件內嵌功能後,模型產生的回答品質明顯提升。

開始使用

只需一行程式碼即可將 Document Inlining 整合到任何 LLM 中,包括無伺服器(serverless)、按需(on-demand)或經過微調的模型。具體方法如下:

程式碼集成

依照 OpenAI API 的視覺模型規範,直接在內容 URL 後面附加 #transform=inline 即可。例如:

inline_content = fireworks.inline_document(file_path=”example.pdf”)

使用者介面使用

在 UI Playground 中,可以為任何模型啟用 “Transform” 選項,直接使用 Document Inlining 功能,無需額外配置。

透過複合 AI 建構更智慧的系統

Document Inlining 展現了複合 AI 系統的強大能力。透過 Document Inlining,我們不再依賴單一的視覺模型來完成所有任務,而是透過專用的解析器和推理模型,實現了更高品質、更快速且更具成本效益的結果。

未來,他們計劃擴展 Document Inlining 的功能,支援更多輸入轉換,包括音訊檔案的內嵌處理,以及長文件的推理時搜尋功能。

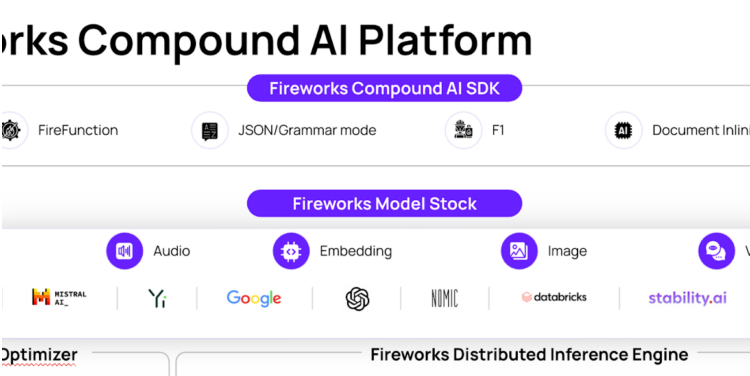

Fireworks:輕鬆建構複合 AI 系統

Fireworks 為 Compound AI 系統建構提供了完整的生態,包括以下四大核心能力:

1. 推理(Inference)

快速、高性價比地運行各種模型和組件。

無需複雜的基礎設施,即可進行不同類型任務的推理。

2. 多模型與多模態支援(Models and Modalities)

提供一站式模型訪問,支援以下模態的任務:

文字(Text)

音訊(Audio)

影像(Image)

視覺理解(Vision Understanding)

使用者無需在不同系統間切換,即可完成複雜的多模態任務。

3. 適應性(Adaptability)

根據具體用例,優化模型的品質與速度。

提供靈活的模型微調選項,滿足不同場景需求。

4. Compound AI 系統管理

透過 Fireworks 框架和工具(如函數呼叫和 JSON 模式),輕鬆協調並執行多個元件。

Compound AI 能夠實現組件化開發,並支援模組之間的高效協作。

Compound AI 的優勢

模組化設計

每個模型專注於特定任務,降低單一模型的複雜性,提升整體表現。

高品質輸出

利用專用解析器處理輸入,推理模型專注於生成和推理任務,減少品質損失。

速度與成本

使用分散式架構並優化任務流程,既降低推理延遲,也減少成本開銷。

未來擴充性

透過引入更多輸入轉換形式(如音訊解析和長文件搜尋),進一步擴展 Compound AI 的應用場景。