阿里雲推出Qwen-2.5-Turbo:刷新100萬Token上下文新高度

阿里雲推出 Qwen2.5-Turbo 專為處理長文字場景設計

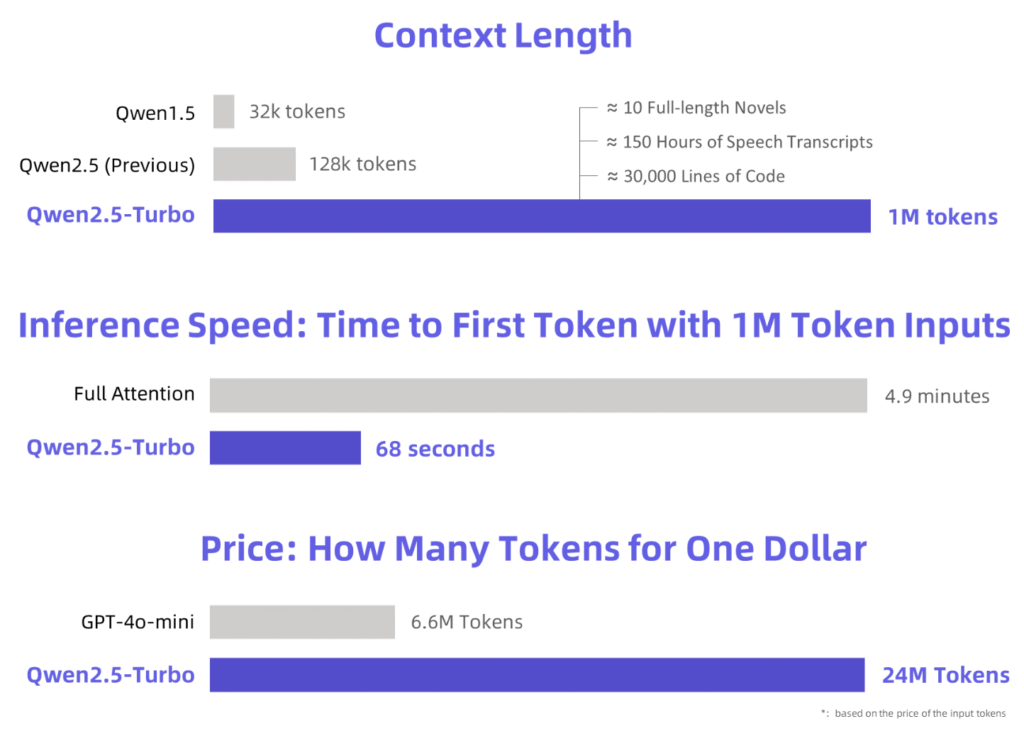

支援 100 萬 Token 的上下文長度,相當於 10 部完整小說、150 小時的語音轉錄或 30,000 行程式碼。

在 Passkey Retrieval 任務中實現 100% 的準確率。

處理 100 萬 Token 的時間從原來的 4.9 分鐘減少到 68 秒,提升 4.3 倍。

處理 100 萬 Token 的費用為 ¥0.3,與 GPT-4o-mini 相比,在相同成本下處理 3.6 倍的內容。

細節捕捉與複雜理解

在超長上下文中,能準確捕捉隱藏訊息,回答複雜問題,並找到大量上下文中的關鍵資訊。

優良的長文本理解能力:

在複雜的長文任務(如 LV-Eval、LongBench-Chat)中表現優於 GPT-4o-mini。

可處理超過 128K Token 的任務場景。

Qwen2.5-Turbo 支援的上下文長度是 GPT-4o-mini 的 8 倍,但短文字任務表現幾乎無損。

推理速度

時間優化:

在 100 萬 Token 輸入下,首次產生 Token 的時間縮短至 68 秒,提升 4.3 倍(原為 4.9 分鐘)。

稀疏注意力機制:顯著壓縮計算量,效率提升 12.5 倍。

硬體相容性:

在多種硬體配置下都能提供穩定的推理速度。

性價比

高效率計算:

在相同成本下,Qwen2.5-Turbo 處理的 Token 數是 GPT-4o-mini 的 3.6 倍。

每處理 100 萬 Token 的費用僅為 ¥0.3。

5. 綜合評價

優於同類競品:在長文本任務中超越 GPT-4 和其他同類模型。

任務適應性強:兼具長文本理解的深度與短文本處理的精準性。

推理效率高:無論在超長文本或複雜任務中,都能以更快的速度完成。